HCIP学习笔记 存储服务规划(四)—— 数据处理与存储服务详解

在HCIP的存储服务规划学习中,数据处理与存储服务是一个承上启下的关键模块。它连接了底层的基础设施与上层的业务应用,是实现数据价值转化的核心环节。本章将深入探讨数据处理与存储服务的内涵、关键技术及规划要点。

1. 数据处理与存储服务的核心定位

数据处理与存储服务,简而言之,是指将原始数据通过一系列处理流程(如清洗、转换、分析)后,以适合业务访问和使用的形式进行存储并提供服务的体系。其目标不仅是安全、可靠地存放数据,更是要让数据易于理解、高效访问并直接支持决策与创新。

2. 关键服务组件与技术

2.1 数据湖与数据仓库

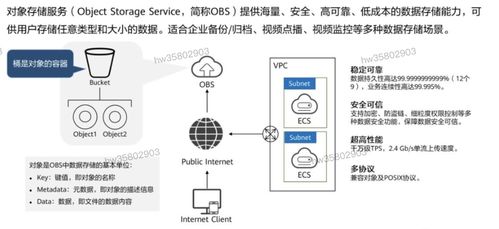

数据湖:通常基于HDFS、对象存储等构建,用于存储海量原始数据(结构化、半结构化、非结构化)。其特点是“先存储,后定义Schema”,适合探索性分析和机器学习场景。

数据仓库:如基于MPP架构的云数据仓库服务,存储的是经过清洗、转换和建模的结构化数据。Schema预先设计,查询性能高,直接服务于BI报表和固定分析。

规划时需根据数据特性、分析时效性(实时/离线)和成本,选择或组合使用两者。

2.2 大数据处理框架

批处理:以Apache Spark、Flink(批模式)、Hadoop MapReduce为代表,处理历史积压的大量数据,适用于T+1报表、数据挖掘等场景。

流处理:以Apache Flink、Spark Streaming、Kafka Streams为代表,处理实时产生的数据流,适用于实时监控、风险预警等场景。

服务规划需明确业务对数据时效性的要求,设计合理的批流融合架构。

2.3 数据管理与治理服务

这是确保数据质量与安全的关键,包括:

- 元数据管理:记录数据的来源、格式、血缘关系,实现数据的可发现与可理解。

- 数据血缘与质量:追踪数据在加工处理过程中的完整链路,并设定质量校验规则。

- 数据安全与权限:通过加密、脱敏、细粒度访问控制(如基于角色的访问控制RBAC)保护数据。

3. 规划要点与最佳实践

- 以业务需求为导向:明确数据分析的目标(如用户画像、精准营销、运营监控),以此反推所需的数据处理能力与存储模型。

- 设计分层存储与处理架构:典型的Lambda或Kappa架构,将原始数据层、明细数据层、汇总数据层与应用数据层分离,平衡性能、成本与灵活性。

- 重视数据生命周期管理:根据数据的访问频率和重要性,制定从热存储(如SSD)、温存储(如高性能云盘)到冷/归档存储(如对象存储、磁带)的自动化策略,优化总体拥有成本(TCO)。

- 拥抱云原生与Serverless服务:充分利用云厂商提供的数据处理(如EMR、Serverless Spark/Flink)和存储(如云数据仓库、Serverless数据湖分析)托管服务,降低运维复杂度,实现弹性伸缩。

- 建立持续的数据治理流程:将数据治理嵌入数据处理流水线,而非事后补救,确保从数据入湖到服务上线的全流程可控、可信。

###

数据处理与存储服务是释放数据潜能的关键。成功的规划要求我们不仅要懂技术(数据湖仓、批流处理),更要懂业务,并建立起完善的数据治理体系。下一部分,我们将聚焦于存储服务的高可用与容灾规划,这是保障上述数据服务连续性的基石。

如若转载,请注明出处:http://www.24zhidao.com/product/58.html

更新时间:2026-05-30 19:34:47